Datanode数据处理中心中的DataXceiver服务 核心组件与数据处理流程解析

在分布式文件系统(如HDFS)的架构中,DataNode作为数据存储与I/O处理的基本单元,承担着数据块(Block)的存储、读写与复制等核心任务。而DataXceiver服务,正是DataNode内部实现高效、可靠网络数据传输的关键组件。本文将深入解析DataXceiver服务的角色、工作原理及其在数据处理流程中的重要性。

一、DataXceiver服务的核心角色

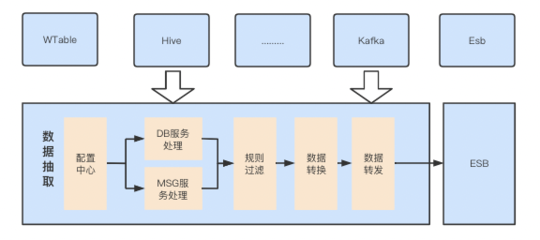

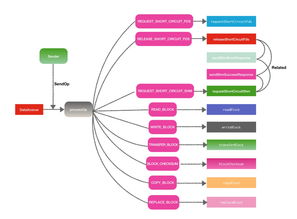

DataXceiver是DataNode中一个独立的服务线程或线程池,专门负责处理所有通过TCP/IP协议流入和流出DataNode的数据传输请求。它并非处理元数据或管理命令(这些由其他服务如DataNode的IPC服务器处理),而是专注于实际数据块的传输。其主要职责包括:

- 处理客户端或其他DataNode的读写请求:当客户端需要读取或写入数据时,最终会与目标DataNode的DataXceiver服务建立连接,进行数据块的传输。

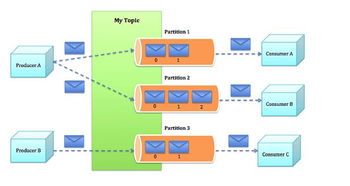

- 处理数据块复制流水线(Pipeline)操作:在HDFS中,为了保证数据可靠性,一个数据块通常会有多个副本。当写入数据或进行副本重新均衡时,DataNode之间会形成一个数据传输流水线,DataXceiver服务负责在这个流水线中接收上游节点的数据并转发给下游节点。

- 处理块恢复和校验操作:在数据块损坏或副本数不足时,DataXceiver也参与副本复制和恢复过程中的数据传输。

二、数据处理流程剖析

以一次客户端写入请求为例,展示DataXceiver的工作流程:

1. 请求发起:客户端从NameNode获取文件对应的数据块及其目标DataNode列表后,会直接与主DataNode(Pipeline中的第一个)的DataXceiver服务建立连接。

2. 流水线建立:主DataNode的DataXceiver会依次与列表中的下一个DataNode的DataXceiver建立连接,形成一个数据传输流水线。

3. 数据传输:客户端将数据包发送给主DataNode的DataXceiver。DataXceiver在将数据包写入本地磁盘的会将其转发给流水线中的下一个DataNode的DataXceiver。下一个DataNode重复此过程,直至数据到达最后一个副本节点。这种流水线方式极大地提高了写入吞吐量。

4. 应答返回:数据包沿流水线传输,确认信息(ACK)则反向传回。客户端从主DataNode收到整个数据块写入成功的确认。

读取流程相对简单:客户端直接与某个持有目标数据块的DataNode的DataXceiver建立连接,请求并接收数据块内容。

三、DataXceiver的设计特点与优势

- 协议优化:DataXceiver使用为HDFS高度定制的、基于TCP的二进制协议,避免了通用HTTP协议的开销,传输效率更高。

- 资源隔离:作为独立的服务,它与DataNode的管理命令处理服务分离,避免了I/O密集型的数据传输操作影响管理功能的响应。

- 高并发处理:通常采用线程池模型,能够同时处理大量并发的数据传输连接,支撑集群的高并发访问。

- 错误恢复机制:内置了完善的错误检测与恢复逻辑,如在流水线传输中某个节点失败,能触发流水线重建,确保数据最终一致性。

四、

DataXceiver是DataNode数据处理中心的“引擎”,是HDFS实现高性能、高可靠数据存取的基础。它抽象并封装了底层复杂的数据网络传输细节,为上层的文件读写、副本复制等操作提供了稳定高效的数据管道。理解DataXceiver的工作机制,对于优化HDFS集群性能、诊断数据传输相关问题具有关键意义。在大数据生态中,正是像DataXceiver这样专注于单一职责的高效组件,共同支撑起海量数据的存储与计算。

如若转载,请注明出处:http://www.zhihongsite.com/product/78.html

更新时间:2026-05-24 23:52:06